Point clé

Avant d'engager des ressources d'ingénierie pour l'IA, évaluez cinq dimensions et comblez des lacunes spécifiques plutôt que d'attendre une préparation parfaite.

La vraie question que posent les fondateurs et les responsables produit n’est pas “devrions-nous ajouter de l’IA ?” Ils ont déjà décidé que oui. La vraie question est : “Sommes-nous prêts à le faire maintenant, ou allons-nous passer six mois à construire quelque chose qui ne fonctionnera pas ?”

Cette question mérite une vraie réponse. La plupart des contenus sur la “préparation à l’IA” n’en fournissent pas. Ils offrent une liste de choses que vous devriez avoir — de bonnes données, des objectifs clairs, l’adhésion de la direction — sans vous dire comment évaluer si vous les avez réellement, ni quoi faire quand vous les avez partiellement.

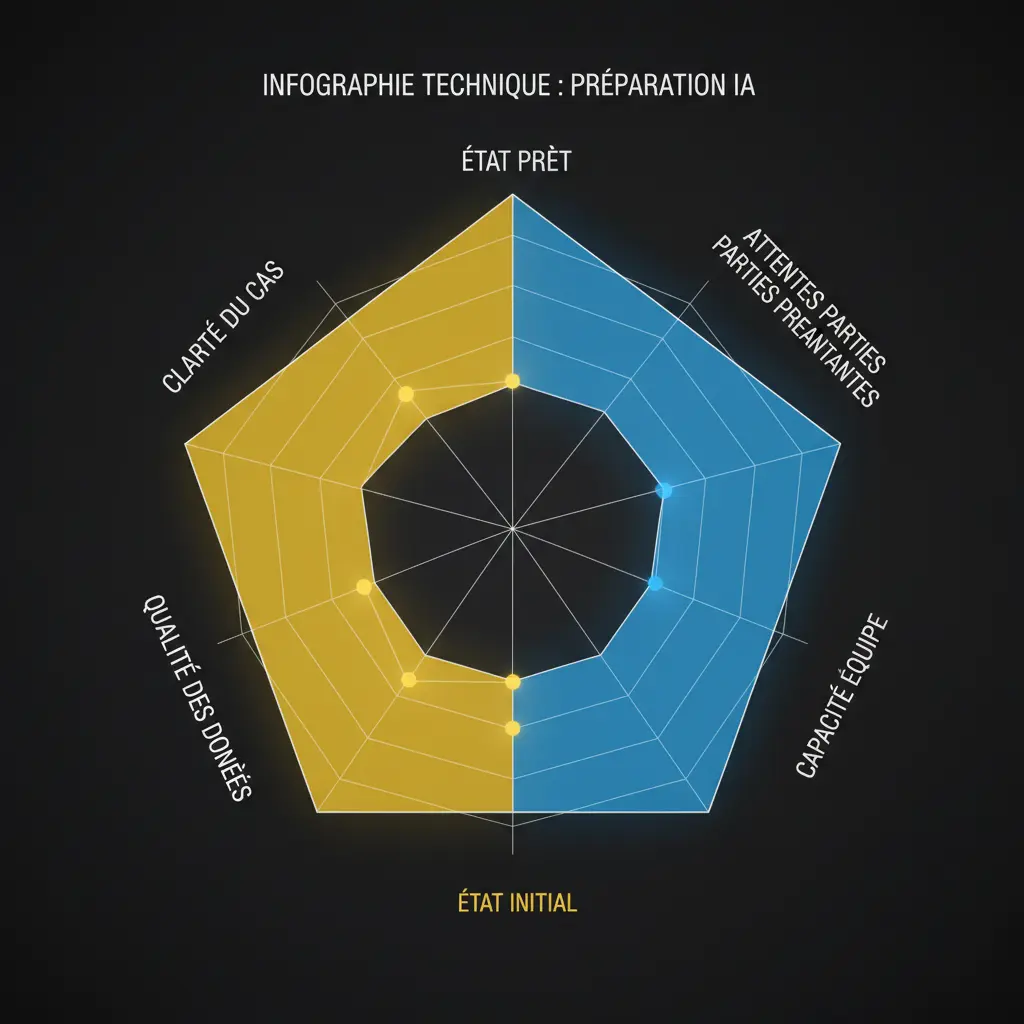

La préparation n’est pas binaire. Vous ne l’avez pas ou vous ne l’avez pas. Vous avez un profil de préparation spécifique sur cinq dimensions, et chaque dimension a des implications différentes sur le fait de pouvoir démarrer maintenant ou de devoir faire quelque chose de précis d’abord.

Les cinq dimensions sont : la clarté du cas d’usage, la qualité et l’accès aux données, l’architecture, la capacité de l’équipe et les attentes des parties prenantes. Travaillez chacune honnêtement. L’objectif n’est pas un score propre. C’est une image précise de là où vous en êtes vraiment.

Dimension 1 : Clarté du cas d’usage

C’est là que la plupart des initiatives IA échouent avant même de commencer — pas dans le code, pas dans les données, mais dans la réunion de planification.

Une ambition IA générale n’est pas un cas d’usage. “Utiliser l’IA pour améliorer l’expérience d’intégration” n’est pas un cas d’usage. “Utiliser un LLM pour analyser l’enregistrement de la session d’intégration et renseigner automatiquement le profil de l’utilisateur avec ses objectifs déclarés et le contexte de son entreprise” est un cas d’usage.

La distinction importe parce que les cas d’usage vagues ne peuvent pas être construits, évalués ou itérés. On ne peut pas savoir si un cas d’usage vague fonctionne.

Signaux indiquant que vous êtes prêts à avancer :

- Vous pouvez décrire la tâche spécifique en une phrase sans utiliser les mots “améliorer”, “enrichir” ou “optimiser”.

- Un humain dans votre produit ou votre entreprise effectue actuellement cette tâche manuellement. C’est votre référence d’évaluation.

- Vous pouvez définir ce à quoi ressemble une sortie correcte en termes mesurables. Pas “la sortie devrait être utile” — quelque chose comme “la sortie devrait classer le ticket entrant dans l’une des 12 catégories avec une précision supérieure à 85 % par rapport à notre ensemble de test étiqueté.”

- Vous avez au moins 20 exemples réels de la tâche bien effectuée que vous pourriez utiliser pour évaluer les sorties de l’IA.

Signaux à traiter d’abord :

- Le cas d’usage est encore au stade “améliorer X avec l’IA” après plus d’une conversation de planification.

- Personne dans la salle ne peut s’accorder sur ce à quoi ressemble une “bonne sortie”.

- Vous n’avez pas d’exemples de la tâche bien effectuée, parce que la tâche n’a jamais été faite auparavant. Une capacité vraiment nouvelle sans référence humaine est plus difficile à évaluer et ne devrait généralement pas être la première fonctionnalité IA que vous livrez.

Si votre cas d’usage n’est pas clair, la bonne décision est un sprint de définition d’une semaine avant d’engager des ressources d’ingénierie. L’objectif : un cas d’usage candidat, décrit en une phrase, avec une définition de sortie correcte et une source d’exemples d’évaluation. Choisissez-en un et avancez.

Dimension 2 : Qualité et accès aux données

La déclaration la plus courante qui bloque les initiatives IA : “Nos données ne sont pas prêtes.” C’est parfois vrai. Plus souvent, c’est un indicateur d’anxiété face à l’engagement, et l’écart spécifique n’est jamais nommé avec suffisamment de précision pour être réellement comblé.

La question n’est pas de savoir si vos données sont parfaites. C’est de savoir si elles sont suffisantes pour le cas d’usage spécifique que vous avez défini, et si les lacunes sont de vrais obstacles ou juste de la friction.

Signaux indiquant que vous êtes prêts à avancer :

- Les données dont votre fonctionnalité IA a besoin existent déjà sous une forme structurée et interrogeable. Pas enfouies dans des PDF ou des fichiers journaux qui nécessitent un travail d’extraction important avant d’être utilisables.

- Les données sont récentes. Pour la plupart des cas d’usage IA produit, les données de plus de 18 à 24 mois produisent des résultats dégradés, sauf si le domaine est très stable — textes juridiques, spécifications produits, archives historiques dans un domaine peu évolutif.

- Vous connaissez le volume dont vous disposez et s’il est suffisant pour votre approche. Le fine-tuning nécessite des milliers d’exemples étiquetés. La génération augmentée par récupération (RAG) évolue avec la taille du corpus. L’ingénierie de prompts sur un modèle pré-entraîné fonctionne avec n’importe quel volume, puisque vous n’entraînez rien.

- Il y a un plan clair pour les informations personnellement identifiables. Si vos données contiennent des informations utilisateurs ne pouvant pas être transmises à un fournisseur de modèle externe, cela nécessite une décision avant que le code d’intégration soit écrit, pas après.

- Quelqu’un possède les données. Une seule personne responsable de leur qualité et de leur accès. La propriété partagée des données produit des problèmes de données qui émergent en production.

Signaux à traiter d’abord :

- Les données existent mais sont mal structurées ou nécessitent un nettoyage important. C’est un sprint de travail, pas un obstacle. Définissez-le et planifiez-le.

- La propriété des données est floue. C’est la décision organisationnelle la plus souvent ignorée. Réglez-la avant de construire.

- La gestion des données personnelles n’a pas d’approche définie. Vos options sont l’anonymisation avant d’envoyer au modèle, l’inférence sur site, ou choisir un cas d’usage différent qui ne touche pas aux champs sensibles. Prenez la décision maintenant.

Dimension 3 : Architecture

Les fonctionnalités IA peuvent souvent être ajoutées à des produits existants avec des changements d’infrastructure modestes. La question est de savoir si votre produit est structuré pour les accepter sans créer un problème de maintenance que vous paierez plus tard.

Signaux indiquant que vous êtes prêts à avancer :

- Votre produit dispose d’une couche API stable que les composants IA pourraient appeler ou par laquelle ils pourraient être appelés. Une API REST ou GraphQL bien définie qui ne change pas fréquemment sous vous offre aux fonctionnalités IA un point d’intégration fiable.

- Votre infrastructure peut gérer les caractéristiques de latence des appels LLM. Les réponses API typiques prennent 1 à 10 secondes. Les workflows agentiques avec plusieurs appels d’outils prennent plus longtemps. Si vos utilisateurs sont dans des flux en temps réel qui tournent déjà proche de la tolérance, vous avez besoin d’un plan pour cela avant de livrer.

- Vous avez de l’observabilité en place — journalisation, suivi des erreurs, alertes — qui peut être étendue pour couvrir les modes d’échec spécifiques à l’IA. Les échecs IA sont différents des erreurs d’application standard. Vous devez pouvoir voir quand la qualité des sorties se dégrade, pas seulement quand les requêtes échouent.

- Vous pouvez déployer des fonctionnalités IA indépendamment du reste du produit, avec des indicateurs de fonctionnalité et un mécanisme de retour arrière. Revenir en arrière sur une mauvaise fonctionnalité IA à 2h du matin ne devrait pas nécessiter un déploiement complet.

Signaux à traiter d’abord :

- Chaque intégration IA va directement dans des composants individuels sans couche d’abstraction partagée. C’est acceptable pour une fonctionnalité. Cela devient un problème de maintenance à trois ou quatre fonctionnalités, quand vous avez une gestion des erreurs séparée, un suivi des coûts et une gestion des prompts dispersés dans la base de code. Construisez un service de passerelle IA léger avant la deuxième fonctionnalité.

- Aucun mécanisme de feedback n’existe pour que les utilisateurs signalent de mauvaises sorties IA. Ce n’est pas une infrastructure optionnelle. C’est comme vous détectez les défaillances systématiques avant qu’elles ne s’accumulent. Un pouce en haut / pouce en bas sur les sorties IA prend deux jours à construire et est l’une des choses les plus précieuses que vous livrerez.

- Aucun système d’indicateurs de fonctionnalité n’est en place. Si vous ne pouvez pas désactiver une fonctionnalité sans un déploiement, le profil de risque de la livraison change significativement.

Dimension 4 : Capacité de l’équipe

Vos ingénieurs sont excellents dans ce qu’ils font. La conception de systèmes IA est une discipline distincte, et l’écart n’est pas un reflet de la capacité. C’est un reflet de l’expérience.

Les modes d’échec dans les fonctionnalités IA sont inconnus des ingénieurs qui n’en ont pas encore livré. Les sorties non déterministes, la sensibilité aux prompts, la gestion de la fenêtre de contexte, la conception de l’évaluation, la récupération d’état agentique — tout cela nécessite des patterns qui ne s’apprennent pas dans le développement logiciel conventionnel. Les équipes qui sous-estiment cet écart livrent des fonctionnalités qui fonctionnent en développement et se dégradent de manière imprévisible en production.

Signaux indiquant que vous êtes prêts à avancer :

- Au moins un ingénieur de l’équipe a livré une intégration LLM en production, pas seulement expérimenté dans un environnement de développement. Le développement ne révèle pas les modes d’échec que la production révèle.

- Votre équipe a de l’expérience dans l’évaluation de la qualité des sorties IA. Pas seulement si le code tourne, mais si les sorties sont correctes. C’est une compétence différente que déboguer un test unitaire qui échoue.

- Quelqu’un dans l’équipe comprend assez bien l’ingénierie des prompts pour itérer quand les sorties sont incorrectes. Traiter le modèle comme une boîte noire produit une fonctionnalité que vous ne pouvez pas améliorer. Quelqu’un doit savoir comment diagnostiquer et corriger les problèmes de qualité de sortie par des modifications de prompts.

- Pour les systèmes agentiques spécifiquement : quelqu’un dans l’équipe a de l’expérience avec des systèmes avec état et la récupération d’erreurs. C’est l’écart de capacité le plus sous-estimé. Les échecs agentiques sont des actions, pas des mots, et récupérer d’un mauvais état dans un workflow multi-étapes nécessite une réflexion différente que récupérer d’une mauvaise réponse API.

Signaux à traiter d’abord :

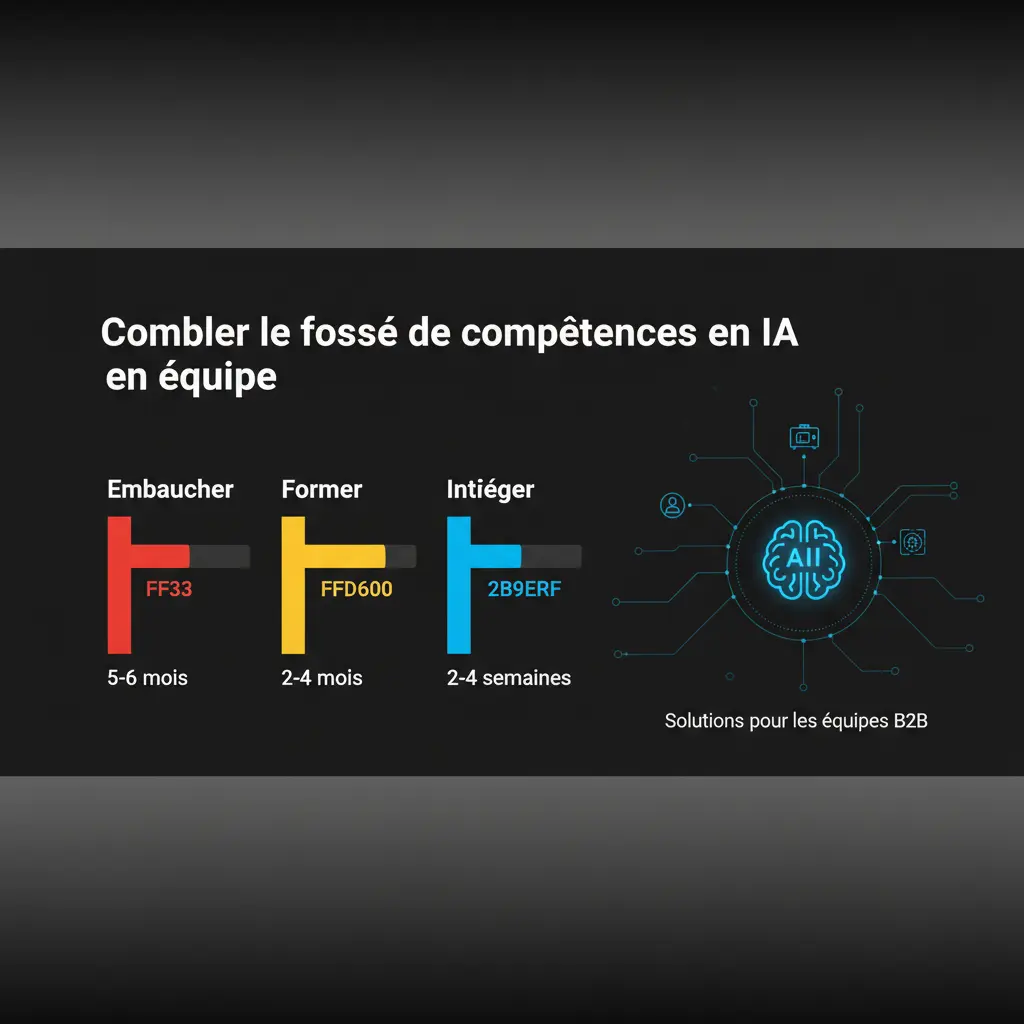

- Personne dans l’équipe n’a livré une fonctionnalité IA en production. Vous pouvez combler cet écart de trois façons : embaucher un ingénieur IA senior (5 à 6 mois pour une première vraie contribution), former l’équipe existante (raisonnable pour les fonctionnalités génératives, plus difficile pour les systèmes agentiques), ou intégrer directement l’expertise IA dans l’équipe. Ce troisième chemin comble l’écart en 2 à 4 semaines plutôt qu’en mois.

- Aucun responsable nommé pour l’initiative IA. Quelqu’un doit être responsable du comportement du système en production — y compris quand il échoue à 2h du matin. Si personne ne le possède, personne ne le corrige.

Dimension 5 : Attentes des parties prenantes

L’équipe peut être prête à construire quelque chose d’excellent tandis que les personnes autour d’elle s’attendent à quelque chose d’irréaliste. Ce décalage tue les initiatives après leur livraison, pas avant.

Signaux indiquant que vous êtes prêts à avancer :

- La direction comprend que les fonctionnalités IA nécessitent 2 à 3 cycles d’itération après le lancement initial avant que les sorties soient suffisamment fiables pour être approuvées à grande échelle. Le premier lancement n’est pas le produit fini. C’est le début de la boucle d’évaluation et d’amélioration.

- Il y a un sponsor exécutif qui contrôle le budget et peut défendre l’initiative quand elle rencontre son premier échec important ou conflit de ressources. Chaque initiative IA en rencontre un. Sans sponsor, la réponse est de déprioritiser.

- Vous avez une définition du succès spécifique et mesurable au-delà de “ça livre”. Une métrique. Une valeur cible. “Précision du routage des tickets de support au-dessus de 85% dans les 60 jours suivant le lancement” est une définition du succès. “Améliorer les opérations de support” ne l’est pas. La définition du succès détermine si l’itération a une direction.

- Vous avez au moins un plan d’incident grossier. Ce qui constitue un échec IA grave — mauvaise sortie atteignant les utilisateurs, taux d’erreur au-dessus d’un seuil, panne du fournisseur de modèle. Qui est alerté. Quelles sont les étapes de réponse. Cela prend une après-midi à documenter.

Signaux à traiter d’abord :

- La direction s’attend à des résultats immédiatement après le lancement. Une fonctionnalité IA qui livre avec 70% de précision et s’améliore à 88% sur trois cycles d’itération est un succès. Si l’attente est de 90% au lancement, l’équipe livrera quelque chose qui n’est pas prêt ou sera blâmée pour des résultats qu’elle ne peut pas contrôler.

- Aucun sponsor n’est nommé. Les initiatives IA sans sponsors ont un taux d’attrition élevé au premier conflit de ressources sérieux. Nommez-en un avant le premier sprint.

- Le succès n’a pas de définition spécifique. C’est inconfortable à définir tôt parce que cela crée une responsabilité. Définissez-le quand même. Vous en avez besoin avant le début du premier sprint, pas après le lancement.

Que faire si la plupart des signaux indiquent “pas encore prêt”

Un faible score de préparation n’est pas un signal de pause. C’est une carte de ce qu’il faut traiter avant d’engager des ressources d’ingénierie.

Les patterns d’écart les plus courants et leurs remèdes :

Cas d’usage flou. Faites un sprint de définition d’une semaine. La sortie est un cas d’usage décrit en une phrase, avec une définition de justesse et une source d’exemples d’évaluation. Pas trois candidats sans décision. Un seul.

Lacunes de données. Nommez l’écart spécifique — étiquettes manquantes, contamination par des données personnelles, pas de propriétaire de données, données obsolètes. Chacun a un remède différent. “Nos données ne sont pas prêtes” n’est pas un écart spécifique. “Nous avons 200 exemples étiquetés et en avons besoin de 1 000” l’est.

Écart de capacité d’équipe. Si vous avez un cas d’usage clair mais personne qui a déjà livré une fonctionnalité IA, le chemin le plus rapide vers la production n’est pas l’embauche. C’est d’intégrer des ingénieurs IA seniors dans votre équipe pendant que vos ingénieurs développent la capacité à leurs côtés.

Décalage des attentes. Ayez la conversation avant le premier sprint. Fixez le calendrier, définissez la métrique de succès, nommez le sponsor, documentez le plan de réponse aux incidents. Quatre heures de conversation d’alignement évitent des mois de friction.

Foire aux questions

Comment évaluer la préparation IA d’un produit ?

Évaluez cinq dimensions : la clarté du cas d’usage (pouvez-vous décrire la tâche en une phrase ?), la qualité des données (les données existent-elles sous forme structurée ?), l’architecture (votre produit peut-il accepter la latence LLM ?), la capacité de l’équipe (quelqu’un a-t-il déjà livré de l’IA en production ?), et les attentes des parties prenantes (y a-t-il un sponsor et une définition de succès mesurable ?).

Quelle est la raison la plus courante d’échec des initiatives IA ?

Les cas d’usage vagues. La plupart des équipes qui sont depuis six mois sur un projet sans rien livrer n’ont pas un problème technique — elles ont un problème de définition. Si personne ne peut s’accorder sur ce à quoi ressemble une sortie correcte, aucun travail d’ingénierie ne pourra y remédier.

Combien de temps faut-il pour combler un écart de capacité d’équipe pour l’IA ?

Embaucher un ingénieur IA senior prend 5 à 6 mois. Former une équipe existante prend 2 à 4 mois pour les fonctionnalités génératives, plus longtemps pour les systèmes agentiques. Intégrer des ingénieurs IA seniors dans votre équipe comble l’écart en 2 à 4 semaines.

Une question avant de construire

Avant le début du premier sprint, répondez à ceci : pouvez-vous décrire la tâche spécifique que votre fonctionnalité IA effectuera, en une phrase, avec une définition de ce à quoi ressemble une sortie correcte ?

Si oui, vous avez assez de clarté pour démarrer. Sinon, c’est le travail à faire avant tout le reste.

La plupart des équipes qui sont depuis six mois sur une initiative IA qui n’a pas encore livré n’ont pas un problème technique. Elles ont un problème de définition auquel des ressources d’ingénierie ont été appliquées avant que la définition n’existe.

Obtenez la bonne définition. Tout le reste est résoluble.

Si vous avez travaillé sur cet état des lieux et souhaitez parler de votre situation spécifique, notre travail de conseil IA commence par une conversation de 30 minutes — pas de présentation, juste vos scores et le chemin le plus direct. Ou contactez-nous pour discuter de votre profil de préparation.